Century LT 私有云 与 NVIDIA DGX

利用 支持 AI 的 数据中心托管 NVIDIA DGX 系统

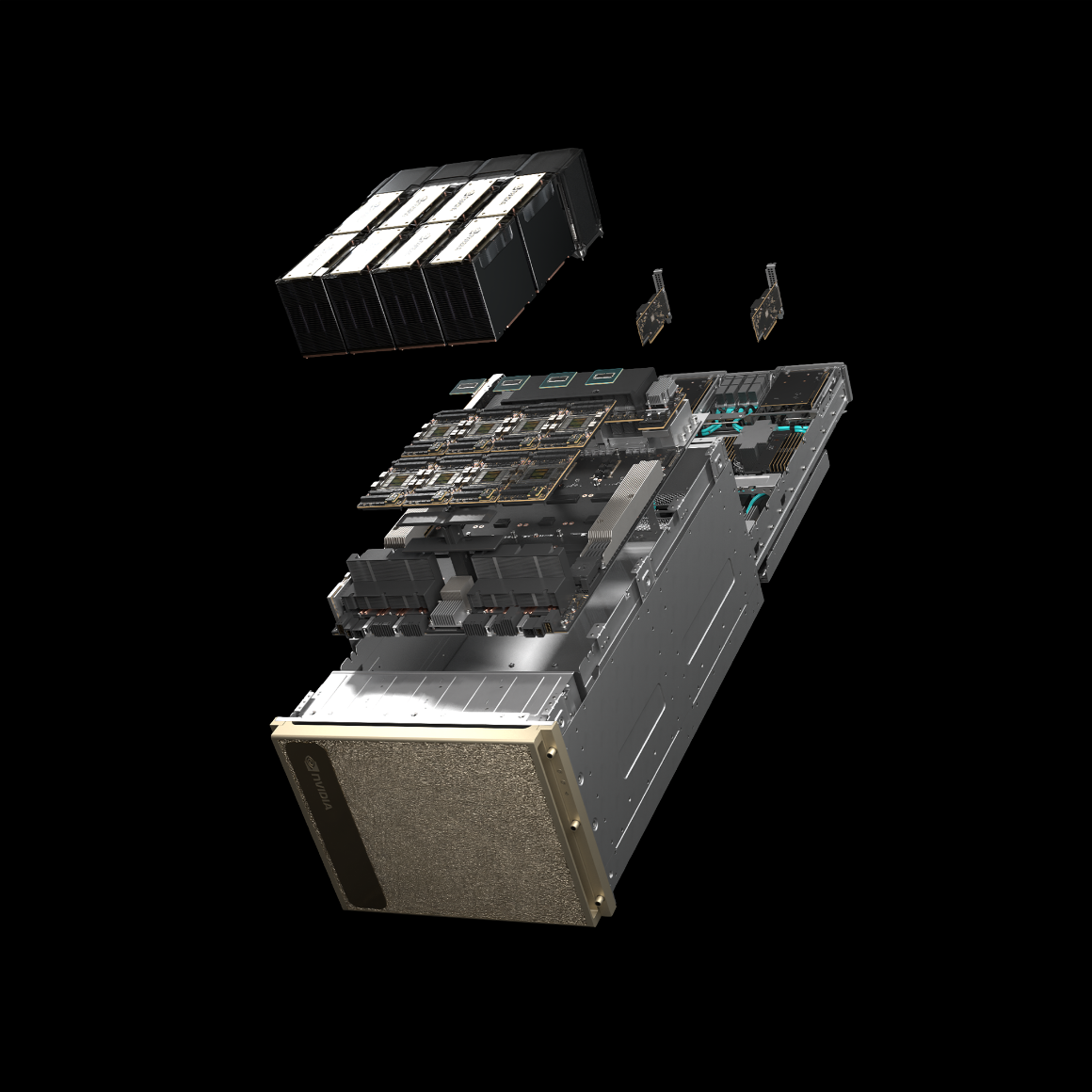

配备 Blackwell GPU 的 NVIDIA DGX SuperPOD™

Century LT 即将推出配备 DGX GB200 系统的 NVIDIA DGX™ B200 和 NVIDIA DGX SuperPOD™。 NVIDIA GB200 Grace Blackwell Superchips 结合了两个 Blackwell GPU 和一个 NVIDIA Grace CPU,与 NVIDIA Hopper 架构一代相比,实时 LLM 推理速度提高了 30 倍,训练性能提高了 4 倍。

NVIDIA DGX™ GB200

具有 72 个 Blackwell GPU 的机架规模架构,用于万亿参数训练和推理。

NVIDIA DGX™ B200

具有 8 个 Blackwell GPU 的下一代性能,适用于各种 ML 工作负载。

NVIDIA DGX™ H800

具有 8 个 Hopper GPU 的当今 ML 基础设施的经过验证的选择。

通过设计、安装、托管和支持,充分利用 NVIDIA DGX

专业知识

获取实现最佳机器学习所需的定制解决方案

快速部署

销售、设计和交付时间表将超出您的预期

灵活交付

选择托管集群或数据中心的本地部署

Guarantee ROI for your NVIDIA DGX™ deployment

with Lambda’s deep learning expertise

Accelerate development with purpose-built software for ML/AI

All DGX systems come with the DGX software stack, including AI frameworks, scripts, and pre-trained models. It also comes with cluster management, network/storage acceleration libraries, and an optimized OS.

Maximize uptime with first-party support by NVIDIA

Get your team up and running quickly with NVIDIA’s onboarding programs and comprehensive hardware, software, and ML support customized to your organization.

Scale efficiently by leveraging Lambda’s expertise in deep learning

Build tailored MLOps infrastructure for your company with consulting from Lambda engineers on machine learning frameworks, training platforms, as well as compute hardware, power, networking, and storage.

Bring infrastructure online faster with less expense

We will install and deploy your machines onsite, or you can use Lambda Colocation to also save on operating expenses.

我们的数据中心

利用安全数据大厅中经过验证的 ML 基础设施,提供 VPN 访问、高带宽互联网访问和云直接连接。

您的数据中心

通过数据中心的本地部署来控制机器学习基础设施的各个方面。由具有大规模 DGX 基础设施专业知识的 NVIDIA 和 Lambda 工程师安装。

保护最新的 GPU,而不会永远被硬件锁定

提供 NVIDIA 生命周期管理服务,以确保您的 DGX 投资始终处于 NVIDIA 架构的领先地位。立即使用当今的最佳解决方案进行部署,并成为第一批过渡到下一代的解决方案之一。 NVIDIA 和 Lambda 工程师管理整个升级和扩展过程,以实现无缝过渡。

%20Page/DGX-H100-3QTR-Left%20(1)4328.png)

NVIDIA DGX™ 系统

从具有 8 个 GPU 的单个 NVIDIA DGX B200 或 H800 系统开始。 DGX 是一个统一的人工智能平台,适用于人工智能管道的每个阶段,从训练到微调再到推理。

- 具有 8 个 NVIDIA B200 Tensor Core GPU 的 10U 系统

- 8U 系统,配备 8 个 NVIDIA H800 Tensor Core GPU

- 用于高速 GPU 到 GPU 通信的 NVLink 和 NVSwitch 结构

- 配备 ConnectX-7 400Gb 网络接口,用于 BasePOD 或 SuperPOD 扩展

- 包括 NVIDIA AI Enterprise 和 NVIDIA 的直接支持

%20Page/superpod.png)

NVIDIA DGX BasePOD™ 和 SuperPOD™

通过 NVIDIA 和 CenturyLT 支持的优化网络、存储、管理和软件平台,将互连 DGX 系统从两个扩展到数千个。

- NVIDIA GB200, B200 或 H800 Tensor Core GPUs

- 从单机架到全数据中心规模

- NVIDIA Quantum-2 InfiniBand 网络架构

- 最高性能的并行存储解决方案

- NVIDIA 的设计、安装、托管和支持